Apple hat für iPhone, iPad, Mac und Vision Pro neue Bedienungshilfen angekündigt, die im Laufe des Jahres veröffentlicht werden sollen. Dazu gehören eine Mac Lupe, Zugriff auf Braille, Barrierefreiheit-Labels im App Store, ein neuer Reader, Updates für „Live Mithören“, und mehr.

Kapitel in diesem Beitrag:

Apple stellt umfangreiche Liste neuer Bedienungshilfen vor

In der Pressemitteilung zum Thema werden mehrere neue Hilfestellungen für die Nutzung von Apple-Geräten beschrieben. Aber nicht nur die Nutzung der Geräte an sich soll damit vereinfacht werden. Auch sollen diese dabei helfen, einfacher mit dem Alltag sowie mit speziellen Situationen umgehen zu können.

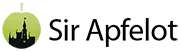

Hervorgehoben wird dabei etwa die neue Mac Lupe, die der Lupe-App des iPhones nachempfunden ist. Mit einer USB-Kamera oder über das Integrationskamera-Feature mit dem iPhone gekoppelt soll sie beim Erkennen von entfernten Objekten und beim Lesen von Texten helfen.

„Barrierefreiheit ist Teil unserer DNA bei Apple“, sagt Tim Cook, CEO von Apple. „Technologie für alle zu entwickeln, hat für uns alle Priorität, und wir sind stolz auf die Innovationen, die wir dieses Jahr vorstellen. Dazu gehören Werkzeuge, die Menschen dabei helfen, auf wichtige Informationen zuzugreifen, die Welt um sie herum zu erkunden und das zu tun, was sie lieben.“

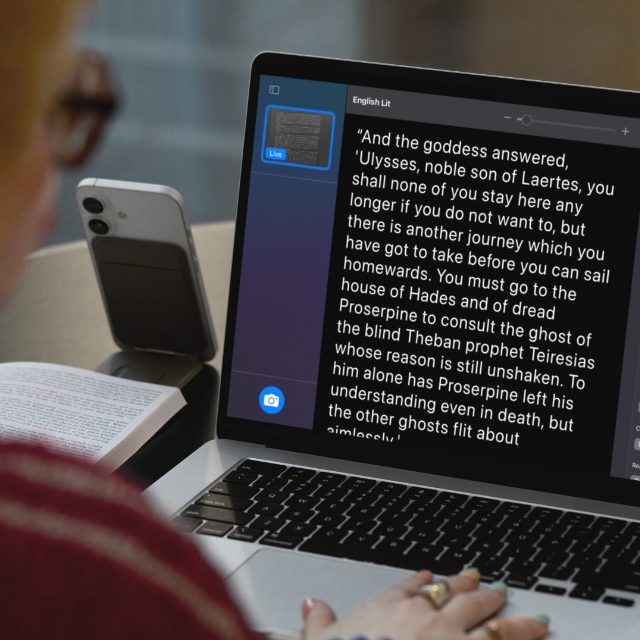

Als Neuerung für iPhone, iPad, Mac und Vision Pro wird dabei der Zugriff auf Braille hervorgehoben – per Braille-Bildschirmeingabe oder angeschlossenem Gerät. Unterstützt wird dabei auch Nemeth Braille für mathematische und naturwissenschaftliche Formeln.

Die neuen Bedienungshilfen für iPhone, iPad, Mac und Vision Pro

Es ist davon auszugehen, dass die neuen Bedienungshilfen für Apple-Geräte als Teil der neuen Hauptversionen von iOS, iPadOS, macOS und visionOS vorgestellt werden. Apple stellt iOS 19, iPadOS 19, macOS 16 und visionOS 3 zum Auftakt der WWDC25 am 9. Juni 2025 vor. Zur Installation freigegeben werden sie dann im Herbst.

Bis dahin muss man also tendenziell noch auf diese Features warten:

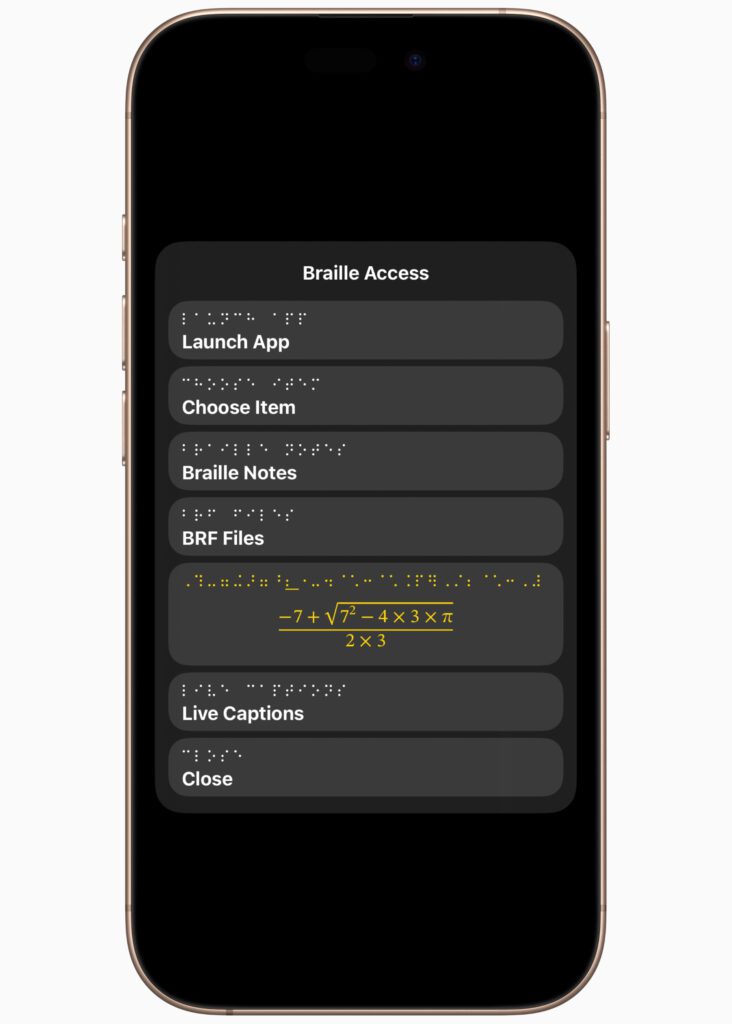

- Produktseiten im App Store bekommen einen neuen Bereich mit Labels zur Barrierefreiheit. So sieht man schon vor dem Herunterladen, ob eine App oder ein Spiel bestimmte Einstellungs- und Anpassungsmöglichkeiten, zusätzliche Erklärungen oder andere Hilfestellungen mitbringt.

- Eine Lupe App für den Mac bringt neben den Vergrößerungs- und Erkennungsfunktionen der seit 2016 auf dem iPhone und iPad nutzbaren Lupe noch weitere Funktionen mit. Für Leute mit eingeschränktem Sehvermögen soll damit die Umgebung zugänglicher gemacht werden. Verschiedene Live-Ansichten sowie Anpassungsmöglichkeiten für Helligkeit, Kontrast und Farbe sollen beim Erkennen helfen.

- Die Unterstützung sowie systemweite Integration von Braille soll die Apple-Geräte in Braille-Notizmöglichkeiten verwandeln. Zudem soll ein spezieller Appstarter dabei helfen, Apps durch Braille-Eingaben aufrufen zu können. Nemeth Braille soll währenddessen bei Berechnungen helfen. Weiterhin sollen Live-Untertitel in Echtzeit auf Braille-Displays transkribiert werden können.

- Außerdem wird es Live Untertitel auf der Apple Watch geben. Live Untertitel in Echtzeit sollen Menschen mit Schwerhörigkeit oder Taubheit dabei helfen, vom iPhone mitgehörte Inhalte direkt lesen zu können. Neben dem iPhone-Display soll das (wahrscheinlich ab iOS 19 und watchOS 12) auch auf dem Apple Watch-Display möglich werden.

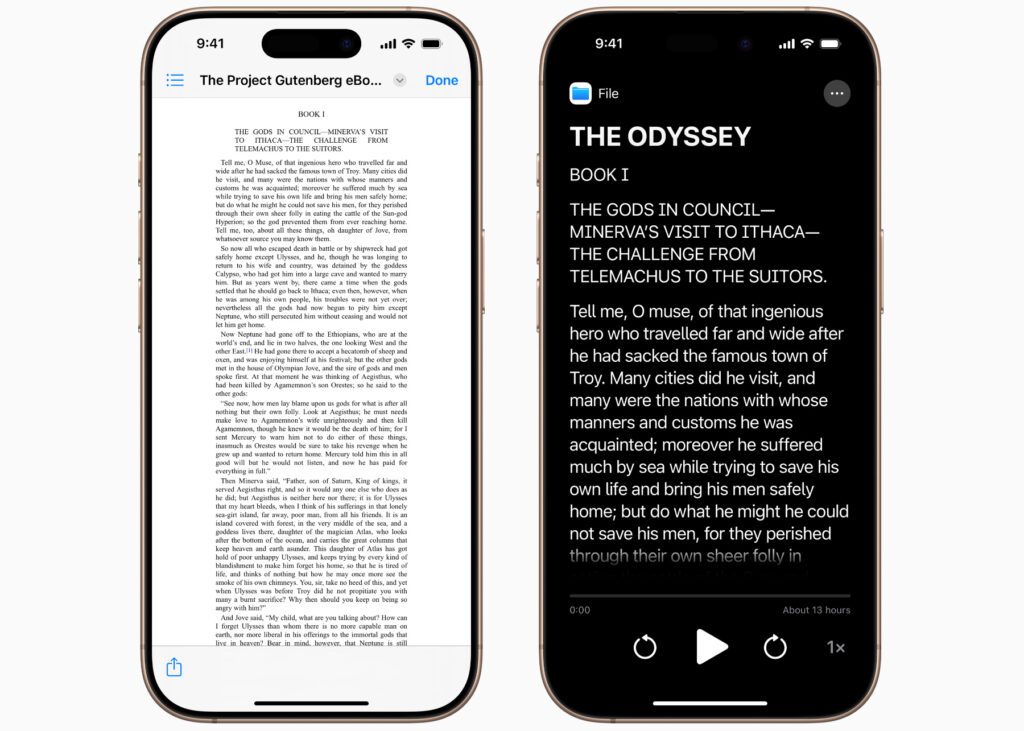

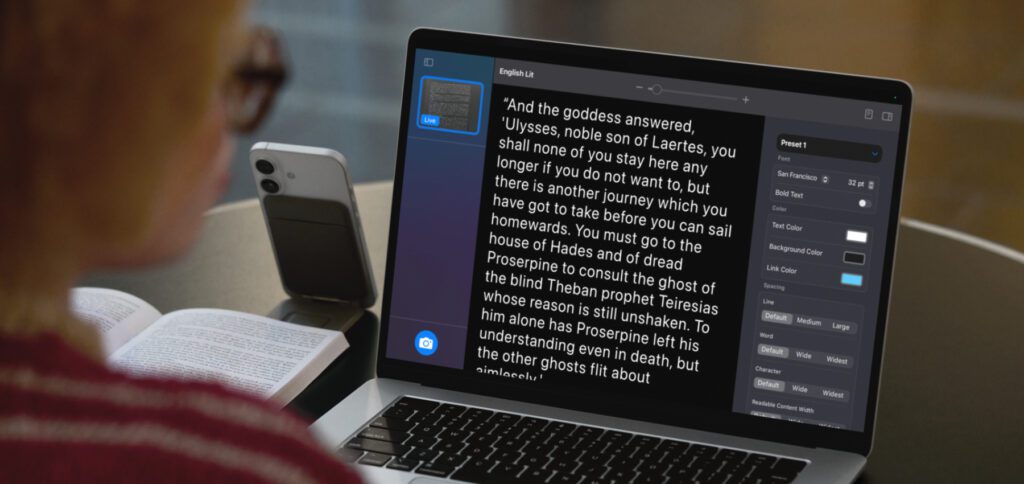

- Systemweit wird der Reader für Barrierefreiheit eingebaut. So soll in verschiedenen Apps und auf Systemebene der angezeigte Text angepasst werden können. Eine einfachere Lesbarkeit für Menschen mit Seheinschränkungen oder Legasthenie soll damit erreicht werden. Optische Anpassungen und die Unterstützung für gesprochene Inhalte sind Teil dieser Bedienungshilfe.

- Weiterhin werden Updates für das Zoom-Feature von visionOS angekündigt. Sie sollen dafür sorgen, dass man die Umgebung vergrößert ansehen kann. Das kann beim Lesen, beim Erkennen von Objekten und Personen sowie in anderen Situationen helfen. Mit VoiceOver soll zudem die Umgebung per Live-Erkennung beschrieben werden können. Weiterhin können Dokumente vorgelesen werden. Eine neue API sorgt für den Kamera-Zugriff per App auf einem anderen Gerät, sodass andere Personen bei der Erkennung der Umgebung helfen können.

- Neue Anpassungsoptionen für Hintergrundgeräusche wurden angekündigt.

- Die „Eigene Stimme“-Funktion soll schneller, einfacher und leistungsfähiger nutzbar werden. Zudem wird sie neben Englisch auch auf Spanisch (Mexiko) verfügbar gemacht. Ob und wann man die Funktion auf Deutsch nutzen kann, das ist unbekannt.

- Die vom iPhone und iPad bekannten Hinweise auf Fahrzeugbewegungen kommen auf den Mac. Zudem wird es neue Anpassungsfunktionen für das Feature auf iPhone, iPad und Mac geben.

- Verbesserungen für Eye Tracking bzw. Blickerfassung sowie für die Schaltersteuerung wurden angekündigt. Die Blickerfassung soll zukünftig die Auswahl durch Verweilen oder durch Schalternutzung ermöglichen.

- Außerdem wurde Head Tracking, also die Erfassung der Kopfbewegung, als neue Steuerungsmöglichkeit angekündigt.

- Die Schaltersteuerung wird unter iOS, iPadOS und visionOS um ein Protokoll für Brain-Computer-Interfaces (BCIs) erweitert. So wird die Gedankensteuerung ohne körperliche Bewegungen und Eingaben möglich. Wann dies für macOS möglich wird, wurde nicht angegeben.

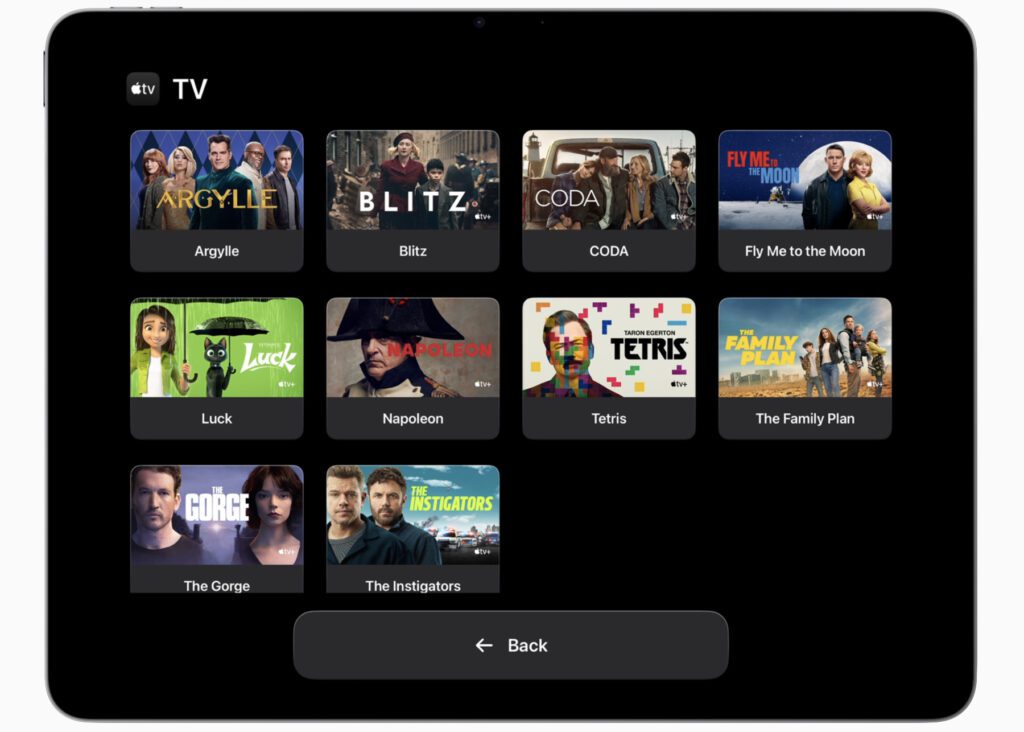

- Der Unterstützende Zugriff wird für die Apple TV App und den Apple TV möglich und enthält eine einfachere Version des Media Players. Developer können vermittels einer API maßgeschneiderte Lösungen für User mit geistigen und entwicklungsbedingten Einschränkungen anbieten.

- Die Musikhaptik am iPhone wird erweitert, sodass man zukünftig die Haptik für einen ganzen Song oder nur für den Gesang auswählen kann. Zudem wird es die Möglichkeit geben, die Gesamtintensität von Klopfen, Texturen und Vibrationen anzupassen.

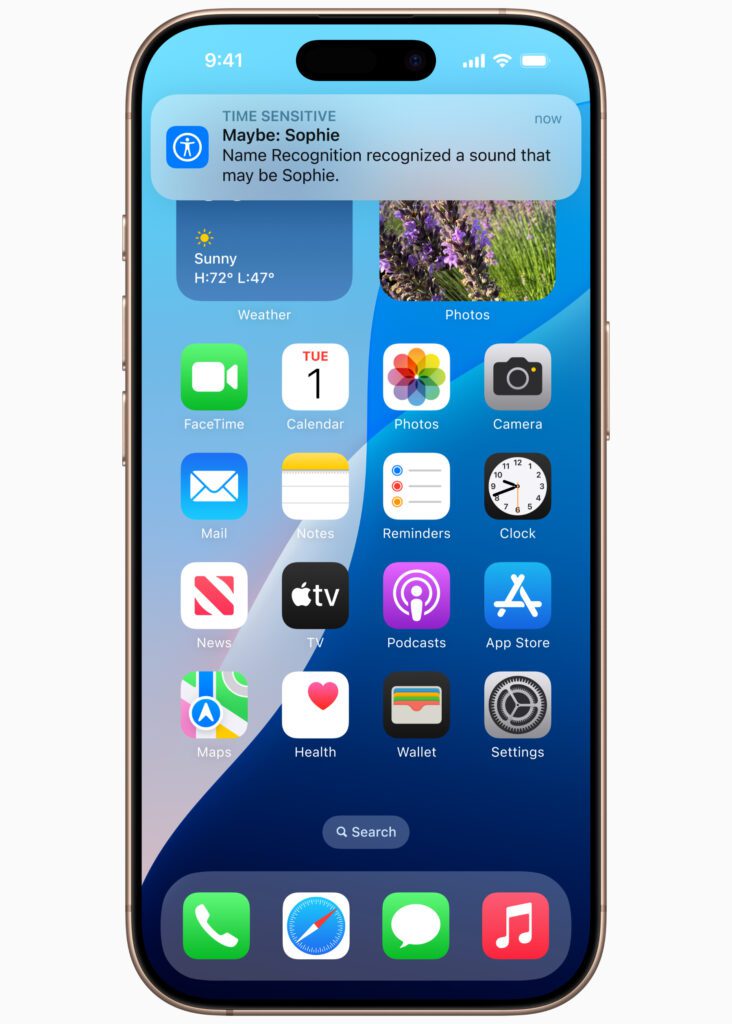

- Die Geräuscherkennung wird um eine Namenserkennung erweitert. So können schwerhörige oder taube Menschen schneller erkennen, wenn sie angesprochen werden.

- Die Sprachsteuerung wird in Xcode eingeführt, sodass Developer mit Einschränkungen einfacher programmieren können. Die geräteübergreifende Synchronisierung des Wortschatzes soll dabei ebenfalls helfen. Sie wird um folgende Sprachen erweitert: Koreanisch, Arabisch (Saudi-Arabien), Türkisch, Italienisch, Spanisch (Lateinamerika), Mandarin-Chinesisch (Taiwan), Englisch (Singapur) und Russisch.

- Live Untertitel werden um Englisch (Indien, Australien, Großbritannien, Singapur), Mandarin-Chinesisch (Festlandchina), Kantonesisch (Festlandchina, Hongkong), Spanisch (Lateinamerika, Spanien), Französisch (Frankreich, Kanada), Japanisch, Deutsch (Deutschland) und Koreanisch erweitert.

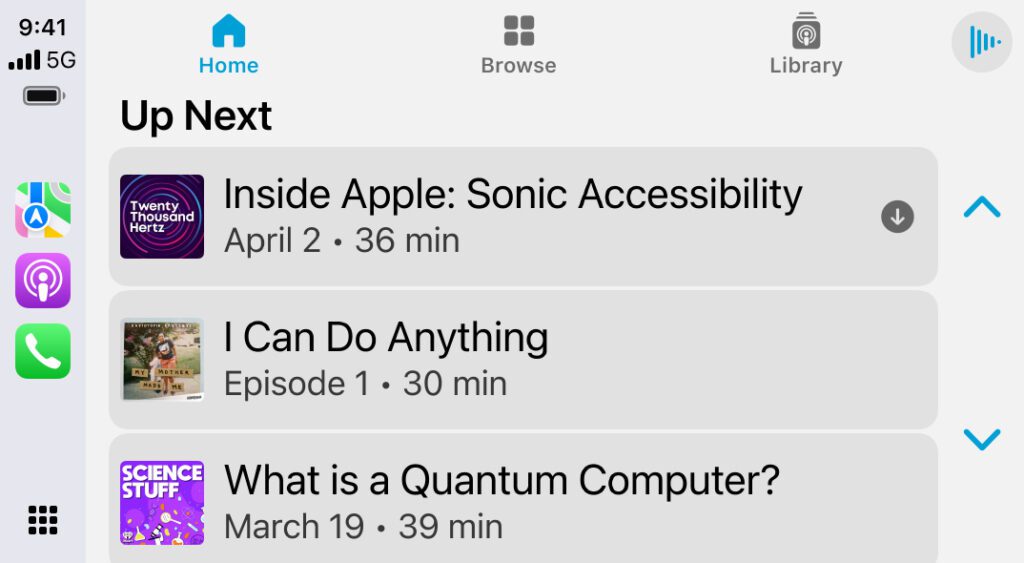

- Für CarPlay wird die Unterstützung von großem Text eingeführt. Hinzu kommt die Geräuscherkennung, etwa für Hupen und Sirenen außerhalb des Fahrzeugs.

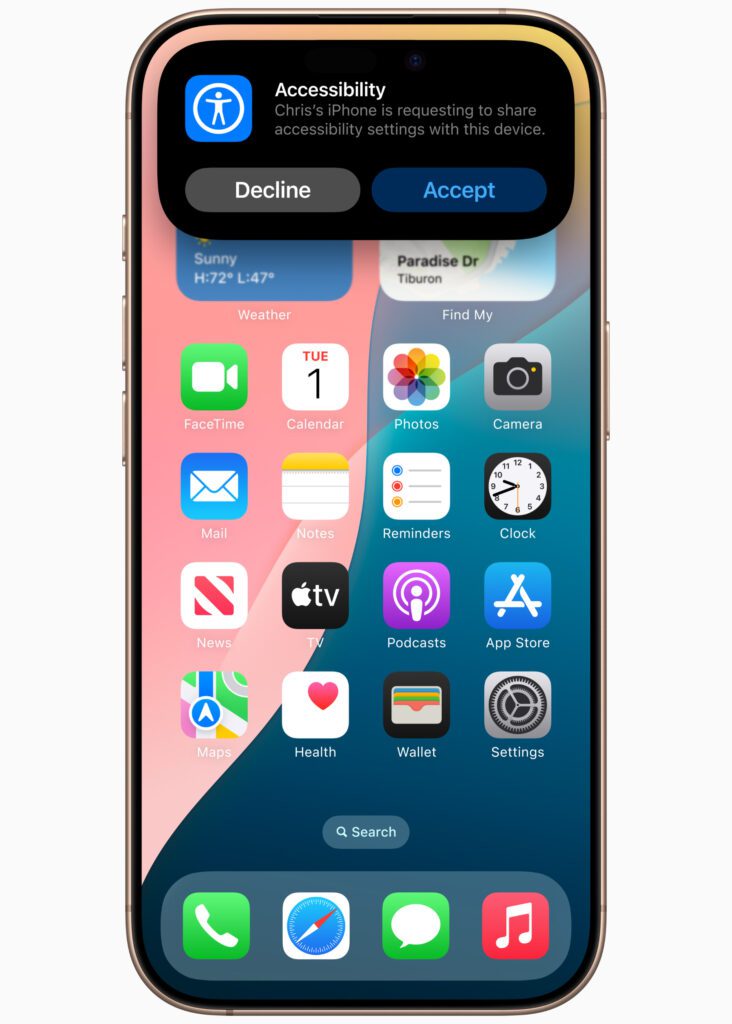

- Einstellungen für Bedienungshilfen teilen ist eine neue Möglichkeit, um Einstellungen für Bedienungshilfen schnell und vorübergehend mit einem anderen iPhone oder iPad zu teilen. Etwa, wenn man sich das Gerät einer anderen Person ausleiht oder einen öffentlichen Kiosk (Gerät im Kiosk-Modus / geführter Zugriff) verwenden möchte.

Ähnliche Beiträge

Johannes hat nach dem Abitur eine Ausbildung zum Wirtschaftsassistenten in der Fachrichtung Fremdsprachen absolviert. Danach hat er sich aber für das Recherchieren und Schreiben entschieden, woraus seine Selbstständigkeit hervorging. Seit mehreren Jahren arbeitet er nun u. a. für Sir Apfelot. Seine Artikel beinhalten Produktvorstellungen, News, Anleitungen, Videospiele, Konsolen und einiges mehr. Apple Keynotes verfolgt er live per Stream.